Distillazione AI senza perdere conoscenza

La distillazione AI trasferisce conoscenza da modelli complessi a versioni più leggere, migliorando efficienza e scalabilità senza sacrificare troppo le prestazioni.

Indice

- Introduzione

- Concetti base

- Teacher

- Student

- Distillazione

- Esempio pratico

- Versioni Mini

- Caso ChatGPT

- Conclusione

Introduzione

La distillazione dei modelli di intelligenza artificiale è una tecnica avanzata utilizzata per trasferire conoscenze da un modello di grandi dimensioni (teacher) a un modello più piccolo e leggero (student). Questo processo consente di ottenere un modello con prestazioni simili a quello di partenza ma con un'efficienza computazionale molto più elevata. La distillazione è ampiamente utilizzata nel settore dell'IA per migliorare la scalabilità e ridurre i costi di calcolo.

Concetti base

Un modello di intelligenza artificiale è un sistema addestrato su grandi quantità di dati per rispondere a domande, generare testo o prendere decisioni basate su input specifici. Nella distillazione, il modello originale, detto teacher, ha accesso a un vasto insieme di dati e può generare previsioni con un alto livello di accuratezza. Il modello student invece è un sistema più compatto, addestrato per imitare il comportamento del teacher utilizzando le sue risposte come guida.

Teacher

Il teacher è il modello più grande, pesante e accurato, addestrato su un'enorme quantità di dati grezzi. Questo modello ha una complessità elevata e una capacità predittiva molto avanzata, ma ha lo svantaggio di richiedere risorse computazionali elevate. Viene utilizzato principalmente per generare risposte dettagliate e precise che verranno poi sfruttate nel processo di distillazione.

Student

Il student è un modello più piccolo e leggero, progettato per operare in ambienti con minori risorse computazionali. Questo modello non viene addestrato direttamente sui dati originali, ma apprende imitando le risposte del teacher. L'obiettivo è ottenere un modello che possa fornire risultati simili al teacher, ma con costi computazionali ridotti.

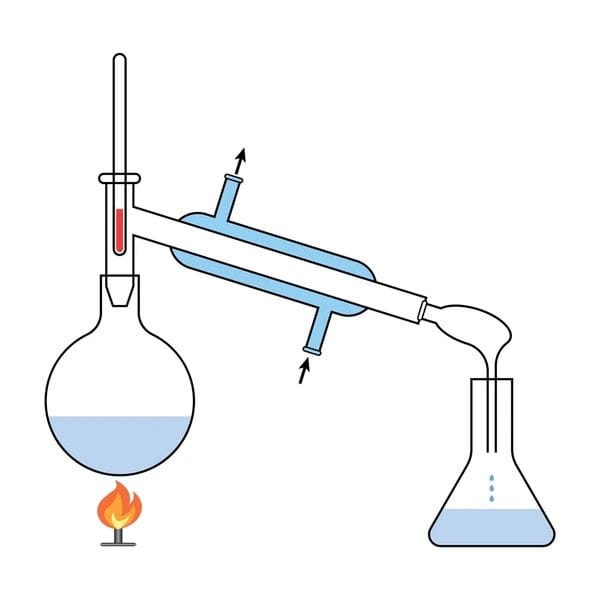

Distillazione

Il processo di distillazione avviene facendo apprendere al modello student non solo le risposte del teacher, ma anche la distribuzione di probabilità associata a tali risposte. In questo modo, il modello più piccolo acquisisce informazioni più dettagliate su come prendere decisioni in maniera simile al modello originale. Questo avviene mediante tre passaggi principali:

- Il teacher elabora l'input e genera una risposta dettagliata con le probabilità associate a ogni possibile risposta.

- Il student viene addestrato utilizzando queste risposte, cercando di imitare la distribuzione delle probabilità prodotta dal teacher.

- Dopo diverse iterazioni, il student raggiunge prestazioni comparabili a quelle del teacher, pur essendo molto più leggero ed efficiente.

Esempio pratico

Un esempio concreto di distillazione può essere osservato nella classificazione di colori. Supponiamo che venga chiesto al modello di rispondere alla domanda: Di che colore sono i limoni?

- Il teacher risponde con una distribuzione di probabilità:

- Giallo: 90%

- Verde: 9%

- Arancione: 1%

- Il student viene addestrato a replicare questa distribuzione. Anche se non ha accesso ai dati grezzi, il suo comportamento si avvicina progressivamente a quello del teacher.

In questo modo, il modello distillato può rispondere a domande simili con un'efficienza molto maggiore rispetto al modello originale.

Versioni Mini

Molte aziende che sviluppano modelli di grandi dimensioni utilizzano la distillazione per creare versioni mini dei loro LLM. Queste versioni ridotte sono pensate per essere più efficienti e adatte a dispositivi con risorse limitate, come smartphone o server con capacità ridotte.

L'obiettivo principale delle versioni mini è ridurre il costo computazionale mantenendo comunque prestazioni accettabili. Ad esempio, un'azienda potrebbe addestrare un modello di grandi dimensioni per generare risposte con una precisione molto elevata, ma utilizzare la distillazione per estrarre un modello più compatto da distribuire ai clienti su dispositivi embedded o in applicazioni cloud a basso costo.

Questi modelli ridotti vengono spesso utilizzati in assistenti vocali, chatbot e applicazioni di intelligenza artificiale in cui la latenza e il consumo di risorse sono fattori critici. L'uso della distillazione consente così di bilanciare prestazioni e accessibilità, garantendo risposte rapide con un impatto minimo sull'hardware.

Caso ChatGPT

Un'applicazione significativa della distillazione riguarda la creazione di modelli derivati da ChatGPT. Il modello originale, GPT-4, rappresenta il teacher, un sistema complesso e pesante, addestrato su una vasta gamma di dati provenienti da fonti diversificate. Tuttavia, per rendere la tecnologia più accessibile e ottimizzata, vengono sviluppati modelli più leggeri attraverso la distillazione.

Il processo prevede che ChatGPT generi risposte a milioni di input, registrando non solo le risposte finali, ma anche la distribuzione di probabilità con cui assegna confidenza alle varie opzioni. Il student, un modello più compatto, apprende da questi dati cercando di replicare i comportamenti e le decisioni del teacher.

Per ottenere questa distribuzione di probabilità, ogni chiamata al modello viene effettuata tramite API specifiche che restituiscono non solo la risposta testuale ma anche le probabilità associate alle varie opzioni di completamento. Questa informazione è accessibile tramite parametri avanzati delle API, che permettono di analizzare il livello di certezza del modello rispetto alle diverse possibilità di output.

Ad esempio, se il modello riceve la domanda Qual è la capitale della Francia?, la risposta sarà Parigi con una probabilità del 99%, mentre altre opzioni come Marsiglia o Lione potrebbero avere probabilità inferiori all'1%. Questi dati vengono registrati e utilizzati per addestrare il modello student, che impara a replicare non solo le risposte, ma anche il livello di sicurezza con cui vengono fornite.

Conclusione

Uno degli aspetti più rilevanti della distillazione è che non si limita a creare un riassunto compatto del modello originale, ma permette di comprendere meglio il funzionamento del teacher. Attraverso l'analisi delle distribuzioni di probabilità delle risposte, è possibile ottenere informazioni sulla logica con cui il modello prende decisioni, migliorando così la capacità di interpretare il comportamento del sistema.

Tuttavia, la distillazione ha anche dei limiti. Il modello student, per quanto efficiente, non potrà mai avere la stessa profondità di conoscenza del teacher, poiché non ha accesso ai dati originali ma solo alle risposte elaborate. Questo significa che potrebbe non riuscire a generalizzare alcune risposte con la stessa precisione o accuratezza del modello più grande.

Nonostante questi limiti, la distillazione rappresenta una strategia essenziale per rendere l'intelligenza artificiale più efficiente e scalabile, permettendo di utilizzare modelli avanzati anche in contesti con risorse limitate.