Transformer e Attenzione: la tecnologia dietro i modelli di IA

I Transformer, modelli avanzati di IA, utilizzano l'attenzione per identificare e collegare parti rilevanti di un testo. Questo meccanismo, veloce e flessibile, trasforma rappresentazioni linguistiche per generare risposte coerenti.

Indice dei Contenuti

- Introduzione

- Idea di Base

- Attenzione

- Perché Funziona Così Bene?

- Perché il Nome Transformer?

- Come Viene Usato l'Attenzione nei Transformer?

- In Parole Semplici

Introduzione

I Transformer sono alla base dei più avanzati modelli di intelligenza artificiale, ma il loro funzionamento è più semplice di quanto sembri. Il concetto chiave è quello di attenzione. Vediamo di cosa si tratta in modo chiaro e accessibile.

Idea di Base

Immagina di leggere una frase complessa, come: "Il gatto, che è salito sull'albero, osservava l'uccello."

Per capire questa frase, devi collegare "gatto" con "osservava" e "uccello" con l'azione di essere osservato. Questo richiede concentrazione su diverse parti della frase, anche se non sono vicine tra loro.

Ecco cosa fanno i Transformer: aiutano un computer a concentrarsi sui pezzi rilevanti di una frase, ignorando il resto.

Attenzione

L'attenzione è un meccanismo che assegna importanza diversa alle parole di un testo. Torniamo all'esempio: "Il gatto, che è salito sull'albero, osservava l'uccello."

Un Transformer attribuirà più peso alla relazione tra "gatto" e "osservava", mentre darà meno importanza a "è salito sull'albero" per comprendere meglio l'azione principale.

In pratica, il modello fa domande come:

- A cosa si riferisce "osservava"?

- Qual è il soggetto principale?

Queste domande aiutano il modello a mantenere il contesto senza perdere il significato globale.

Perché Funziona Così Bene?

- Cattura Connessioni Distanziate: Anche se due parole sono lontane nella frase, il modello riesce a collegarle.

- Parallelo e Veloce: Può analizzare intere frasi o testi contemporaneamente, non una parola alla volta.

- Flessibilità: Può essere applicato a linguaggi naturali.

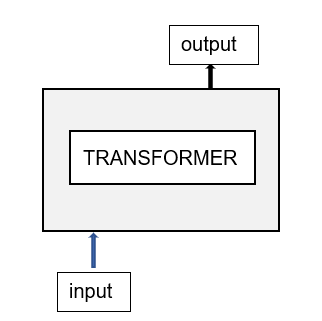

Perché il Nome Transformer?

Il termine "Transformer" deriva dall'idea di trasformare una rappresentazione linguistica in un'altra. Questo concetto è centrale nel funzionamento del modello: un Transformer prende una sequenza di input, come una frase, e la trasforma in una sequenza di output attraverso il meccanismo di attenzione. Questa capacità di trasformazione lo rende versatile e adattabile, permettendogli di gestire traduzioni, risposte a domande, generazione di testo e molto altro.

In altre parole, il nome riflette l'obiettivo principale del modello: trasformare il modo in cui le informazioni vengono rappresentate e processate per produrre risultati utili.

Come Viene Usato l'Attenzione nei Transformer?

Quando viene sottoposta una frase nuova mai vista prima, come in un prompt dato a ChatGPT, il modello applica lo stesso meccanismo di attenzione. Ogni parola del prompt viene analizzata rispetto a tutte le altre, e il modello genera una rappresentazione interna che cattura le relazioni tra le parole.

Anche senza aver mai visto quella frase, il Transformer sfrutta le conoscenze acquisite durante l'addestramento per identificare pattern linguistici e costruire connessioni logiche.

Ad esempio, se la frase fosse: "L'autobus era pieno e i passeggeri parlavano a bassa voce", il modello potrebbe dare più peso a "autobus" e "pieno" per comprendere il contesto principale, collegandoli a "passeggeri" e "parlavano" per dedurre il significato generale. Questo avviene grazie alla capacità del Transformer di generalizzare le relazioni linguistiche apprese da milioni di esempi precedenti.

Il risultato è che, anche per una frase mai vista prima, il modello riesce a generare risposte rilevanti e coerenti, basandosi sul contesto fornito dal prompt e sulle connessioni create tramite l'attenzione.

In Parole Semplici

Un Transformer è come un lettore molto intelligente che:

- Legge una frase intera in una volta.

- Decide quali parole sono più importanti per il significato.

- Collega tra loro le parole chiave, ignorando il "rumore".

Questo è ciò che consente ai modelli di intelligenza artificiale come ChatGPT di generare risposte così naturali e coerenti.